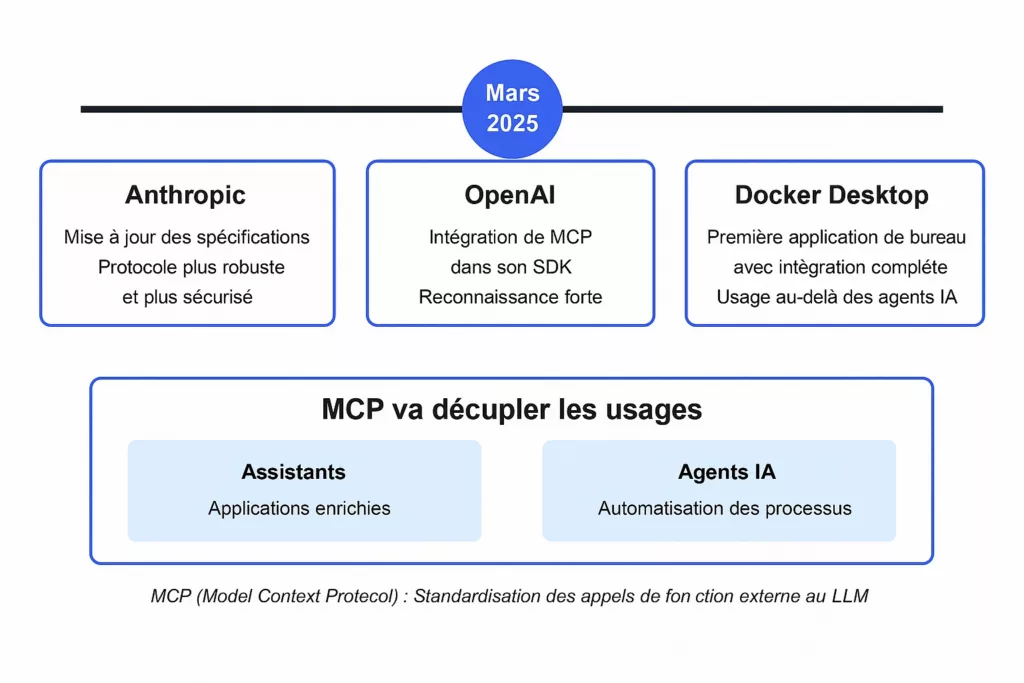

Ça fait quelques mois que l’on voit arriver MCP (Model Context Protocol) comme étant une vague puissante pour les Agents IA. Mais jeudi dernier trois nouveautés sont apparues qui vont encore accélérer son développement :

- Anthropic annonce une mise à jour des spécifications qui va rendre le protocole plus robuste et plus sécurisé (https://spec.modelcontextprotocol.io/specification/2025-03-26)

- OpenAI annonce qu’il va intégrer MCP dans son outillage d’agent, alors que l’origine de MCP vient d’un concurrent, Anthropic. C’est une reconnaissance qui va renforcer son adoption (https://x.com/sama/status/1904957253456941061)

- Une première application de bureau, Docker Desktop, l’a complètement intégrée dans sa solution. Ce qui illustre le potentiel pour des applications au-delà des agents IA (https://docs.docker.com/desktop/features/gordon).

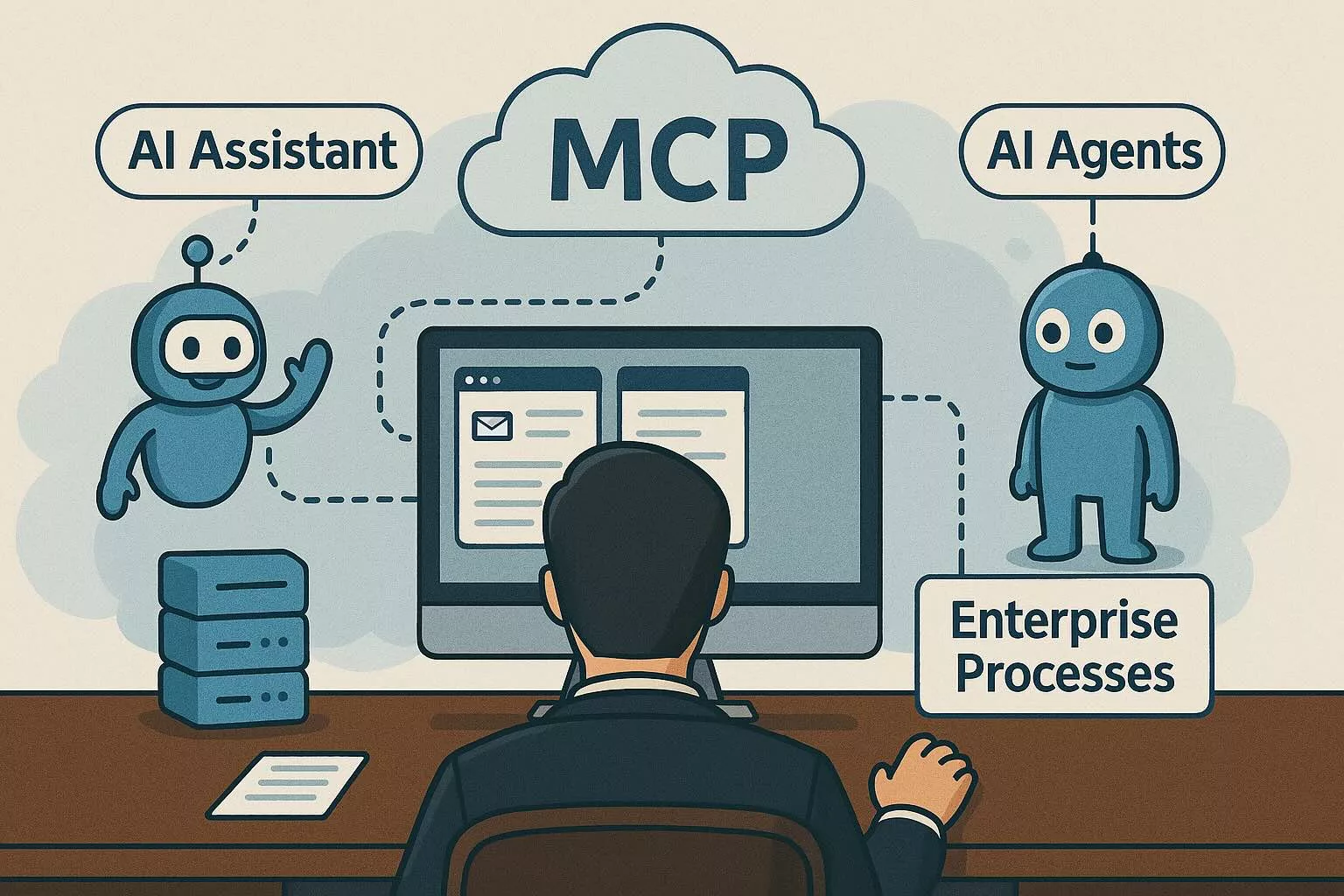

Le principe de MCP

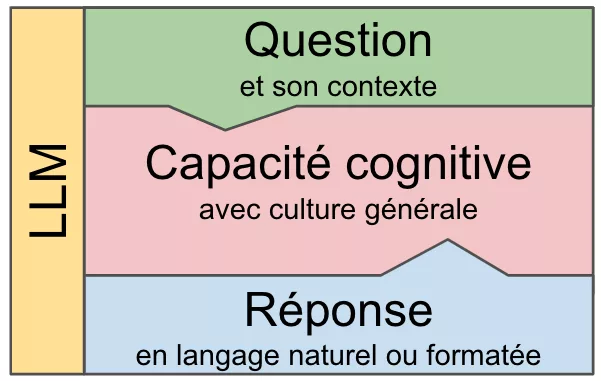

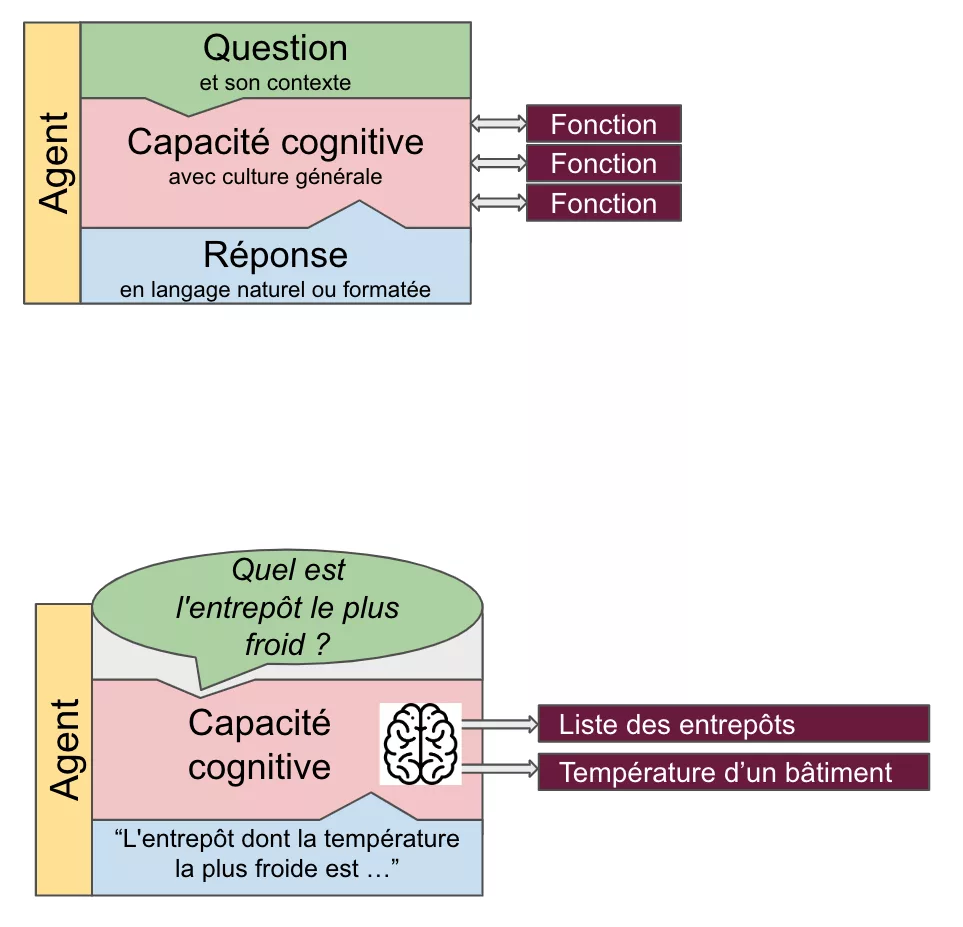

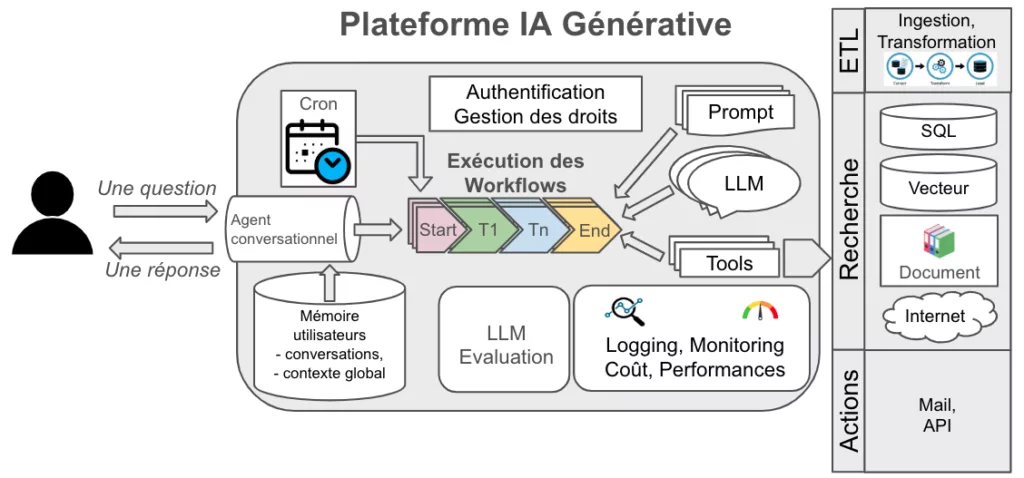

Les agents IA s’appuient sur les LLM. Mais un LLM c’est de l’intelligence brute. Il faut lui adjoindre des fonctions pour faire le lien avec l’extérieur, pour chercher de l’information ou pour agir sur l’environnement. Anthropic a proposé en novembre 2024 une standardisation de l’appel de ces fonctions, c’est le fameux MCP (Model Context Protocol).

Une adoption très rapide du protocole

Depuis, un mouvement de fond s’est lancé pour intégrer cette norme. Des centaines d’outils de toutes sortes se sont créés pour augmenter les possibilités des LLM. TODO un ex …

Les agents IA, les premiers consommateurs de ressources MCP

Les premiers générateurs d’agents l’avaient bien intégré. Citons Smolagents, N8N ou même LangChain qui avait sa propre standardisation avec les Tools. L’intégration par OpenAI dans son propre kit de développement va amplifier les propositions de services utilisant ce protocole.

Mais les applications de bureau vont pouvoir aussi bénéficier de MCP

Quelques applications commençaient à intégrer des LLM sous forme d’assistant. La possibilité d’enrichir très facilement ces assistants avec de nouvelles possibilités va accélérer l’arrivée des assistants dans toutes les applications de bureau.

Avec Claude Desktop, une première illustration du potentiel d’intégration LLM<>MCP

Prenons l’application de bureau d’Anthropic qui permet de dialoguer avec son propre LLM Claude. Étant à l’origine de MCP, c’est une des premières applications pouvant intégrer des serveurs MCP. En lui ajoutant un serveur MCP ayant accès aux documents présents dans l’ordinateur (ex : desktop-commander), l’application devient un outil pour développeur informatique à qui on peut demander son avis sur un projet local ou de modifier un morceau de programme.

Un deuxième exemple plus abouti, avec Ask Gordon de Docker

Jeudi dernier, lors du meetup Generative AI Paris 27@Meta, la société Docker a présenté la possibilité d’ajouter un assistant « Ask Gordon » basé sur MCP pour aider l’utilisateur dans ses démarches avec leur application Docker Desktop. C’est une aide contextuelle pour optimiser et dépanner les conteneurs, automatiser les tâches Docker, et fournir des recommandations basées sur l’analyse des fichiers locaux.

Dorénavant, toutes les applications vont pouvoir intégrer des assistants IA utilisant des services MCP

On peut même imaginer que progressivement l’interface de dialogue remplacera une partie importante des interactions avec des formulaires comme actuellement.

Les assistants conversationnels (ChatBot) vont aussi intégrer MCP

Progressivement, les assistants conversationnels existants vont certainement aussi remplacer leur mécanisme de plugin par l’intégration de MCP. Les principaux chatbots open source, comme LibreChat ou LobeChat ont commencé. Et OpenAI vient aussi de l’annoncer pour très bientôt.

Mais c’est un protocole encore naissant

L’annonce de jeudi d’Anthropic sur l’intégration de OAuth 2.x va améliorer la gestion de la sécurité. Mais il y a encore beaucoup à faire, pour que les autorisations des outils MCP soient, par exemple, subordonnées aux droits spécifiques de chaque utilisateur.

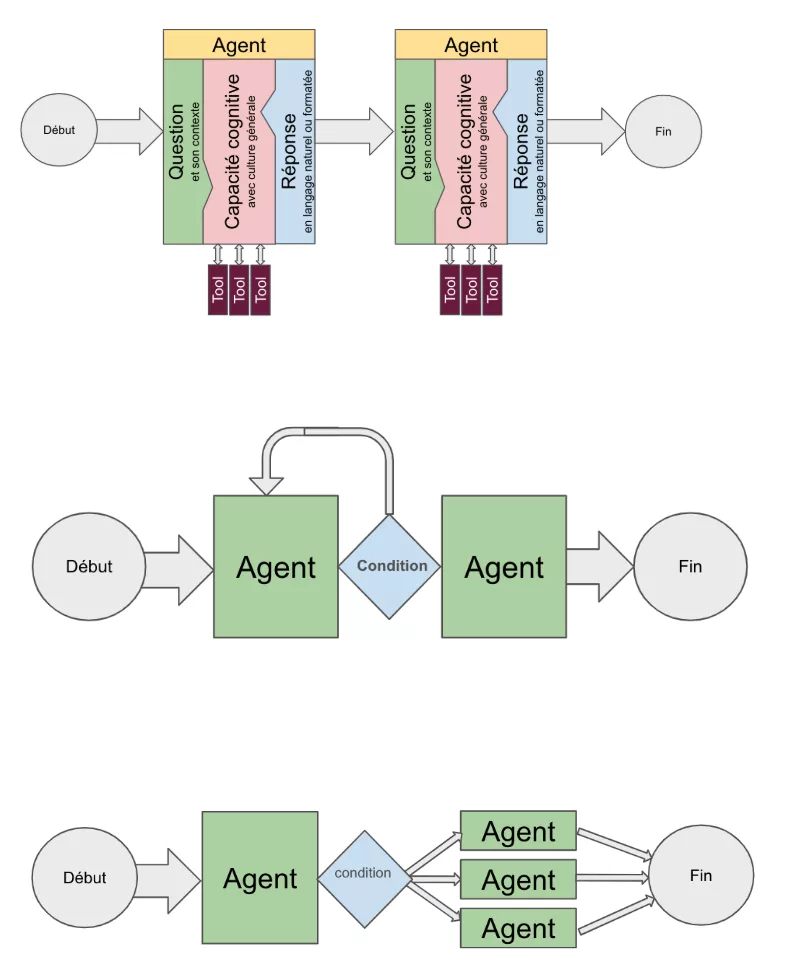

Vers le multi-agent

La facilité d’ajout de nouvelles possibilités à un LLM va accroître les risques qu’il ne sollicite pas correctement le bon outil pour une demande donnée. La solution est alors de créer plusieurs agents et regrouper les fonctions par domaine d’expertise. Bienvenue alors dans le monde des orchestrateurs d’agents, comme CrewAI, Semantic Kernel ou LangGraph.

En conclusion, MCP va décupler les usages des Agents mais aussi des Assistants

MCP, par la standardisation des appels de fonction externe au LLM, facilite la construction de solutions à base d’IA Générative. Tous les départements de l’entreprise peuvent en bénéficier, soit au niveau des applications qui vont être enrichies avec des assistants ou du nombre de processus d’entreprise qui vont pouvoir être automatisés avec des agents IA.

Encore un peu perdu avec toutes ces possibilités qui se dessinent ? Vous voulez bénéficier de la puissance de l’IA Générative pour simplifier vos applications, orchestrer vos agents à l’échelle de l’entreprise ? Contactez-moi.i